Các cáo buộc về tội phạm tình dục đang được dư luận Hàn Quốc quan tâm những ngày qua. Một loạt phòng chat Telegram với tổng số hơn 212.000 người tham gia đã bị phát hiện. Để có thể truy cập vào các phòng chat này, người ta phải gửi một bộ ảnh của bất kỳ cô gái nào, chẳng hạn như bạn cùng lớp, anh chị em ruột hoặc bạn bè, và cung cấp thông tin cá nhân của người đó.

Xuất hiện nhiều phòng chat chứa hình ảnh, video không đứng đắn, làm nhục nạn nhân. Bên cạnh đó, cư dân mạng đưa ra bằng chứng hàng trăm thần tượng nữ cũng là nạn nhân của phim khiêu dâm sử dụng deepfake.

Nhiều nữ ca sĩ, diễn viên Hàn Quốc là nạn nhân deepfake khiêu dâm

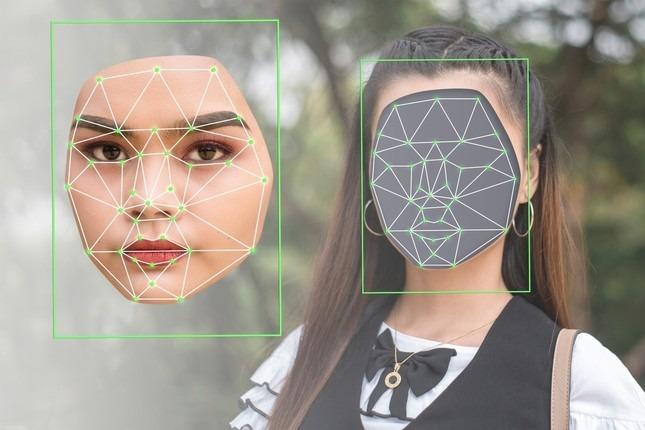

Deepfake là thuật ngữ chỉ những bức ảnh, video hoặc âm thanh dùng trí tuệ nhân tạo chỉnh sửa lấy từ nội dung trên mạng xã hội hoặc các phương tiện khác mà không có sự đồng ý của chính chủ và phát tán trực tuyến.

Theo báo cáo Security Hero do Wall Street Journal chia sẻ, Hàn Quốc là quốc gia có tội phạm phát tán nội dung khiêu dâm phạm pháp trên không gian kỹ thuật số. Theo đó, 96.000 video từ 10 trang web khiêu dâm deepfake và 85 kênh deepfake trên các nền tảng chia sẻ video được phân tích trong hai tháng, 53% cá nhân xuất hiện trong phim khiêu dâm deepfake là ca sĩ và diễn viên Hàn Quốc.

Một trang web có tên của hơn 200 nữ thần tượng Kpop đến từ các nhóm nhạc khác nhau lan truyền trên Twitter. Các hình ảnh trên web đều là ảnh đã qua chỉnh sửa. Ngoài ra có nhiều trang có nội dung khiêu dâm nói chung, sử dụng công nghệ deepfake để ghép mặt nạn nhân vào ảnh, video đồi trụy. Một số nội dung, người dùng phải trả tiền để xem tiếp.

Dư luận bày tỏ sự phẫn nộ, kêu gọi các công ty quản lý thần tượng hành động chống lại nội dung khiêu dâm được can thiệp bởi deepfake.

Hình ảnh của Sakura nhóm LE SSERAFIM và ảnh bị chỉnh sửa, ghép vào nội dung khiêu dâm.

Hàn Quốc tuyên bố tìm cách trừng phạt nghiêm khắc đối với tội phạm tình dục deepfake thông qua Telegram. Tổng thống Yoon Suk Yeol kêu gọi chính quyền tăng cường nỗ lực trấn áp tội phạm tình dục kỹ thuật số để chống lại nội dung deepfake do AI tạo ra.

"Các video deepfake nhắm vào những cá nhân không xác định đã lan truyền nhanh chóng trên mạng xã hội. Nhiều nạn nhân là trẻ vị thành niên và hầu hết thủ phạm cũng được xác định là thanh thiếu niên" - Tổng thống Yoon Suk Yeol nói.

Theo cơ quan cảnh sát của nước này, 297 vụ phạm tội deepfake liên quan đến nội dung tình dục đã được báo cáo trong 7 tháng đầu năm, tăng từ 180 vụ vào năm ngoái và gần gấp đôi số vụ năm 2021. Trong số 178 người bị buộc tội, 113 người là thanh thiếu niên.

Hôm 28/8, tội phạm deepfake bị kết án 5 năm tù sau khi sản xuất khoảng 400 video khiêu dâm bịa đặt và phát tán khoảng 1.700 video có nội dung tương tự lên mạng xã hội.

Hàn Quốc đang tiến hành trấn áp tội phạm tình dục kỹ thuật số nhắm vào phụ nữ và trẻ em tạo nội dung khiêu dâm deepfake.

Năm 2020, kẻ đứng sau đường dây deepfake - Cho Ju Bin - bị kết án 42 năm tù vì tống tiền ít nhất 74 phụ nữ, trong đó có 16 thanh thiếu niên. Y gửi những hình ảnh khiêu dâm mang tính hạ nhục, bạo lực tinh thần nạn nhân.

Theo luật pháp Hàn Quốc, hành vi tạo video deepfake có nội dung khiêu dâm với mục đích phát tán sẽ bị phạt tù 5 năm hoặc phạt hành chính 50 triệu won (37.500 USD), The Guardian đưa tin.

Vấn nạn deepfake khiêu dâm trên thế giới

Hồi tháng 3, Channel 4 News công bố 5 trang web deepfake được truy cập nhiều nhất đã phát hiện. Gần 4.000 người nổi tiếng được liệt kê, trong số đó có 255 người Anh.

Trong số đó có các diễn viên nữ, ngôi sao truyền hình, nhạc sĩ và KOLs YouTube. Khuôn mặt của họ được ghép vào nội dung khiêu dâm bằng trí tuệ nhân tạo.

Theo kết quả điều tra, 5 trang web này đã nhận được 100 triệu lượt xem trong vòng ba tháng.

Người dẫn chương trình của Channel 4 News Cathy Newman, là 1 trong 4.000 nạn nhân cho biết: "Cảm giác như bị xâm phạm. Rất đáng sợ khi có người ngoài kia dựng nên chuyện này, tôi không thể nhìn thấy họ, và họ có thể nhìn thấy phiên bản tưởng tượng, giả mạo này của tôi".

Các ông lớn mạng xã hội thực hiện các biện pháp bảo vệ người dùng dù còn nhiều lỗ hổng. Người phát ngôn của Google cho biết: “Chúng tôi hiểu nội dung này có thể gây đau buồn như thế nào. Chúng tôi cam kết sẽ phát huy các biện pháp bảo vệ hiện có để giúp đỡ những người bị ảnh hưởng.

Ryan Daniels đến từ Meta, công ty sở hữu Facebook và Instagram, cho biết: "Meta nghiêm cấm hình ảnh khỏa thân của trẻ em, nội dung khiêu dâm hóa trẻ em và các dịch vụ cung cấp hình ảnh khỏa thân không được sự đồng ý do AI tạo ra. Mặc dù deepfake vẫn có sẵn trên nhiều ứng dụng, chúng tôi đã xóa các quảng cáo này và các tài khoản đằng sau chúng".

Theo Tiền Phong