Cuối tháng 1, X (Twitter) tràn ngập hình ảnh khiêu dâm của Taylor Swift do trí tuệ nhân tạo (AI) tạo ra. Những kẻ xấu sử dụng deepfake - phương tiện tổng hợp đã được điều khiển bằng kỹ thuật số để thay thế chân dung của người này bằng chân dung của người khác - giả mạo “Công chúa nhạc đồng quê”.

Vụ việc nghiêm trọng đến mức X chặn tạm thời các tìm kiếm về tên nữ ca sĩ và có liên quan đến cô, đồng thời chặn vĩnh viễn thuật ngữ “deepfake”. Nền tảng mạng xã hội cũng cảnh báo người dùng không được đăng tải hình ảnh khỏa thân không có sự đồng thuận, nếu vi phạm sẽ bị xử lý.

Vụ Taylor Swift bị phát tán ảnh khiêu dâm do AI tạo ra cảnh tỉnh mọi người trước tác hại của công nghệ deepfake.

Sức ảnh hưởng của Taylor khiến Chính phủ Mỹ không thể làm ngơ trước vấn nạn mới. Thư ký báo chí Nhà Trắng Karine Jean-Pierre cam kết làm tất cả điều có thể để giải quyết vấn đề, đồng thời kêu gọi các nền tảng truyền thông xã hội có giải pháp quản lý nội dung.

Về phía giọng ca Safe & Sound dù chưa chính thức lên tiếng, nguồn tin của Daily Mail cho hay người đẹp sinh năm 1989 đang cân nhắc có hành động pháp lý chống lại việc bôi nhọ hình ảnh.

Không chỉ người hâm mộ Taylor, mà cả fan Kpop mong mỏi nàng “rắn chúa” có động thái cụ thể chống lại vấn nạn deepfake. Trước nữ ca sĩ Mỹ, nhiều thần tượng Hàn Quốc từng rơi vào tình huống tương tự nhưng chưa có giải pháp hữu hiệu nào được đưa ra để bảo vệ họ.

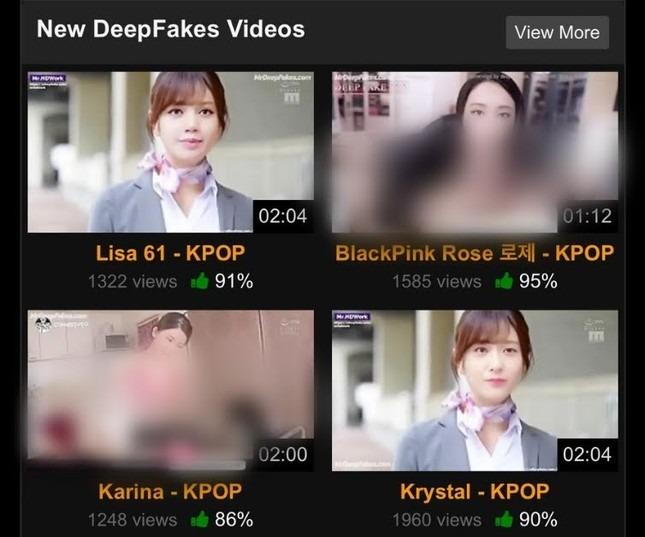

Kết quả thống kê năm 2021 cho thấy 25% nạn nhân của deepfake là nữ thần tượng Kpop. Một trang web chuyên cung cấp nội dung khiêu dâm deepfake công khai giới thiệu các thần tượng, thậm chí xếp hạng họ theo mức độ phổ biến về lượt xem.

Thời điểm đó, bản kiến nghị với hơn 200.000 chữ ký được gửi đến Nhà Xanh, nhưng dường như chính quyền Hàn Quốc chưa có đối sách gì bởi tình trạng giả mạo ảnh khiêu dâm vẫn tiếp diễn. Phần lớn nội dung nhan nhản trên X và “lách” kiểm duyệt bằng viết lái tên thần tượng. Ví dụ: Jungkook của BTS trở thành BT5 Jungk00k, Jennie của BlackPink trở thành J3nn!3 của BL@CKP!NK...

Lisa, Rosé của BlackPink cùng nhiều nữ thần tượng Kpop khác là nạn nhân của deepfake.

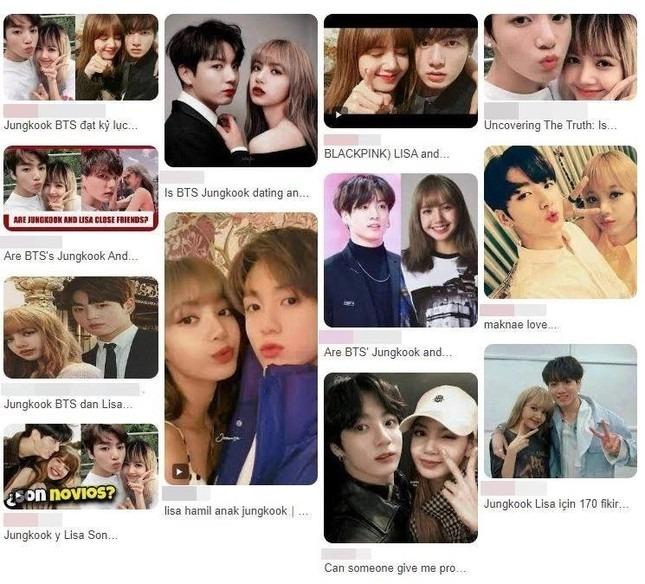

Giữa năm 2023, video về Jungkook và Lisa được lan truyền rộng rãi. Trong đó, hai ngôi sao ngồi cạnh nhau, trao đổi ánh mắt và Jungkook vuốt ve tay Lisa. Một clip khác lại chiếu loạt ảnh bộ đôi ôm nhau thân thiết. Tất cả hình ảnh đều chỉnh sửa bằng AI nhưng chân thực đến mức nhiều cư dân mạng bị nhầm lẫn và tin chúng là thật.

Điều đó làm dấy lên hồi chuông cảnh báo về sự thiếu trong sạch của không gian ảo. Ngay cả những điều mắt thấy tai nghe cũng chưa chắc là sự thật. Mọi người không biết tin vào cái gì. Hơn thế, nó cũng cho thấy thực trạng quyền hình ảnh của các thần tượng không được bảo đảm.

Tháng 9/2023, cơ quan công tố Hàn Quốc thông báo một sinh viên Hàn Quốc du học ở Mỹ (trong độ tuổi 30), được gọi là Mr.A, đã tạo và phát tán hàng nghìn hình ảnh khiêu dâm của sao Kpop dưới 18 tuổi.

Từ tháng 8/2019 đến tháng 6/2023, A tạo ra 2.300 video nhạy cảm bằng công nghệ deepfake. A xử lý kỹ thuật số khuôn mặt của các thần tượng và người nổi tiếng vị thành niên khác để tạo ra vẻ ngoài giống người trưởng thành.

Dù không bán tài liệu, A phát tán khoảng 5.800 video khiêu dâm thông qua phòng trò chuyện độc quyền chỉ dành cho thành viên trên Telegram và các nền tảng tương tự. Người ta xác nhận rằng ít nhất 50 người nổi tiếng là nạn nhân của anh ta.

Cảnh sát Hàn Quốc tìm thấy phòng chat Telegram của A vào tháng 12/2022. Ngay sau đó, lực lượng chức năng đã xin lệnh bắt giữ, vô hiệu hóa hộ chiếu của A, đồng thời yêu cầu sự hợp tác của chính quyền Mỹ thông qua hệ thống thông báo đỏ của Interpol. A chính thức bị bắt vào tháng 6/2023. Tòa án Mỹ từ chối đơn xin bảo lãnh và trục xuất A về Hàn Quốc không lâu sau đó. Anh ta bị còng tay đến sân bay Seoul vào ngày 22/8/2023.

A khai nhận bắt đầu sản xuất và phát tán video giả mạo sau khi vô tình nhìn thấy chúng trên mạng xã hội khi còn ở Hàn Quốc. Tất cả hành vi phạm tội chỉ để thỏa mãn nhu cầu cá nhân.

Những bức ảnh giả mạo của Jungkook và Lisa làm dấy lên lo ngại về sự an toàn của không gian mạng.

Theo Tiền Phong