“Ngựa ô” lĩnh vực chip AI

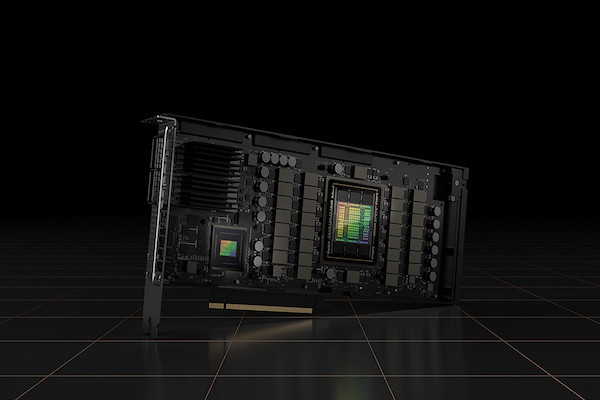

Những gã khổng lồ như Microsoft và Google đang trong cuộc chiến tích hợp AI vào công cụ tìm kiếm của mình, trong khi đó những công ty tỷ đô như OpenAI và Stable Diffusion cũng trong một cuộc đua phát hành phần mềm ra công chúng. Đằng sau các ứng dụng AI đình đám này là con chip Nvidia A100, có giá lên tới 10.000 USD.

Nathan Benaich, nhà đầu tư trong lĩnh vực AI, cho biết A100 đang là “ngựa ô” với các chuyên gia trí tuệ nhân tạo thời điểm hiện tại. Theo New Street Research, công ty Nvidia chiếm đến 95% thị trường bộ xử lý đồ hoạ sử dụng trong máy học.

A100 phù hợp với các mô hình máy học đứng sau những công cụ như ChatGPT, Bing AI hay Stable Diffusion. Nó có thể thực hiện đồng thời nhiều phép tính đơn giản, yếu tố quan trọng cho đào tạo và sử dụng các mô hình mạng thần kinh (neural-network).

Các công ty lớn và startup phát triển những phần mềm như chatbot hay chương trình tạo hình ảnh cần hàng trăm, hàng ngàn vi xử lý của Nvidia. Họ cần tự sắm phần cứng hoặc tận dụng sức mạnh chip thông qua điện toán đám mây.

Để huấn luyện mô hình trí tuệ nhân tạo, chẳng hạn như mô hình ngôn ngữ lớn, sẽ cần tới hàng trăm vi xử lý đồ hoạ (GPU). Những con chip phải có sức mạnh đủ xử lý hàng terabyte dữ liệu một cách nhanh chóng để nhận dạng mẫu. Tiếp đó, các GPU như A100 có nhiệm vụ sử dụng các thuật toán mô hình để “suy luận”, tạo ra văn bản, các dự đoán hoặc xác định đối tượng bên trong hình ảnh.

Điều này đồng nghĩa nhu cầu đối với A100 là rất lớn. Theo ước tính từ State of AI, hãng chuyên theo dõi các thực thể sử dụng A100 (không bao gồm các nhà cung cấp dịch vụ đám mây), cách đây 1 năm, Stability AI chỉ có 32 chiếc A100, nhưng con số hiện tại đã lên hơn 5.400 GPU. Stability AI là công ty phát triển Stable Diffusion, công cụ tái tạo hình ảnh thu hút nhiều sự chú ý vào mùa thu năm ngoái, hiện đang được định giá hơn 1 tỷ USD.

Bước ngoặt chiến lược kinh doanh

Dù báo cáo doanh thu quý IV cho thấy tổng doanh thu công ty giảm 21%, nhưng giá cổ phiếu vẫn tăng 14%, chủ yếu do tín hiệu tích cực từ mảng kinh doanh chip AI khi doanh số chip trung tâm dữ liệu tăng 11%, lên hơn 3,6 tỷ USD cùng kỳ.

Nvidia là nhà sản xuất chip được hưởng lợi từ xu hướng AI hiện nay. Đến nay, cổ phiếu Nvidia đã tăng 65%, vượt xa chỉ số S&P 500 và các cổ phiếu lĩnh vực bán dẫn khác.

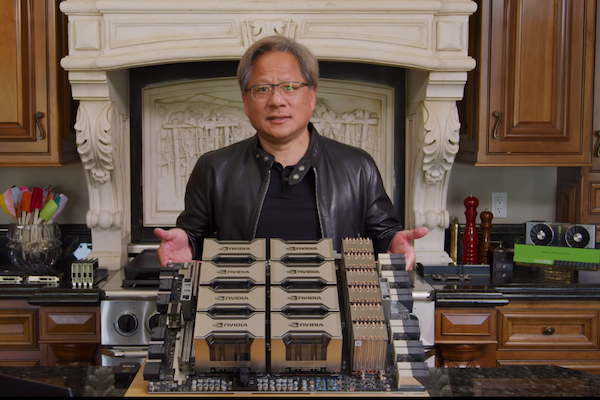

CEO công ty, Jensen Huang, liên tục nhắc tới AI trong buổi báo cáo doanh thu, cho thấy sự bùng nổ của AI sẽ là trọng tâm trong chiến lược của công ty.

“Hoạt động xung quanh cơ sở hạ tầng AI mà chúng tôi xây dựng, đưa Hopper (tên mã của chip thế hệ mới H100) và Ampere (chip A100) vào sử dụng trong mô hình ngôn ngữ lớn đã tăng vọt trong 60 ngày qua”, Huang nói. “Không còn nghi ngờ gì nữa, bất kể kế hoạch ban đầu là gì, định hướng của công ty đã thay đổi mạnh mẽ dựa vào kết quả kinh doanh của 60 hay 90 ngày gần đây”.

Cuộc cạnh tranh mới

Nvidia không phải công ty duy nhất sản xuất GPU cho ứng dụng AI. AMD, Intel hay thậm chí các công ty đám mây như Google và Amazon cũng đang phát triển các vi xử lý được thiết kế riêng cho tác vụ AI.

Tuy nhiên, các công ty kể trên sẽ gặp nhiều thách thức đến từ “ông vua” đương nhiệm. Theo State of AI, đến hết tháng 12 năm ngoái, hơn 21.000 nghiên cứu nguồn mở về AI cho biết họ đang sử dụng phần cứng của Nvidia.

Phần lớn các chuyên gia đã sử dụng con chip V100, được Nvidia ra mắt từ năm 2017. Trong khi đó, A100, với sự tăng trưởng nhanh chóng, đang là phần cứng được sử dụng nhiều thứ ba của hãng, chỉ sau các GPU dành cho game thủ có giá dưới 1.500 USD.

A100 cũng là con chip nằm trong giới hạn xuất khẩu vì lý do quốc phòng. Năm ngoái, Nvidia cho biết chính phủ Mỹ yêu cầu phải có giấy phép đặc biệt nếu công ty này muốn bán A100 và H100 cho Trung Quốc, Hồng Kông và Nga.

Trước đây nhà sản xuất chip này đã phải thực hiện một số điều chỉnh trong sản phẩm dành cho thị trường Trung Quốc nhằm đáp ứng các yêu cầu về hạn chế xuất khẩu của Mỹ.

Hiện con chip có khả năng soán ngôi A100 là H100, người kế nhiệm của nó. A100 được giới thiệu lần đầu tiên vào năm 2020, trong khi đó H100 mới ra mắt vào năm ngoái và đang đi vào giai đoạn sản xuất hàng loạt. Thực tế, Nvidia đã ghi nhận doanh thu từ H100 cao hơn so với A100 dù con chip đời sau này có giá tiền đắt hơn trên mỗi chiếc.

Nvidia cho biết H100 là GPU trung tâm dữ liệu đầu tiên được hãng tối ưu hoá cho tác vụ biến đổi (transformer), một kỹ thuật ngày càng quan trọng trong ứng dụng AI hàng đầu.

Thế Vinh(Theo CNBC)